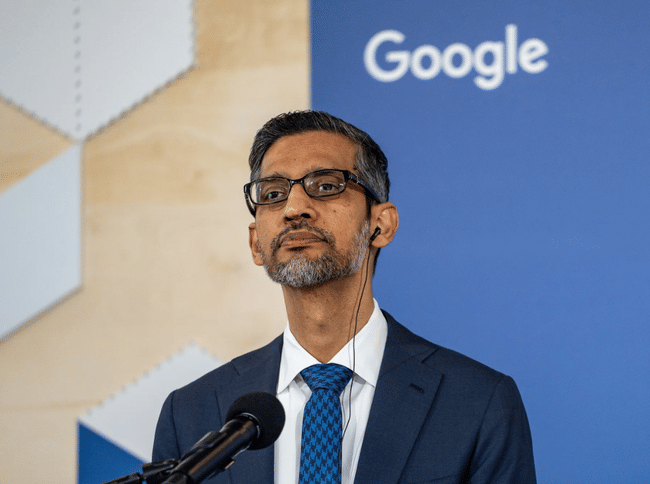

W Google wraca spór, czy firma powinna zarabiać na sztucznej inteligencji używanej w wojsku. Otwarty list podpisany przez ponad 580 pracowników – w tym badaczy z DeepMind i menedżerów wyższego szczebla w Google Cloud – wzywa CEO Sundara Pichaia, by odrzucił negocjowane z Pentagonem kontrakty na wykorzystanie modeli Gemini w środowiskach ściśle tajnych, gdzie systemy działałyby na odseparowanych, „air‑gapped” sieciach, bez realnej możliwości monitorowania ich użycia.

Organizatorzy mówią o „ponad 580” podpisach, inne relacje zaokrąglają tę liczbę do około 600, przy czym mniej więcej dwie trzecie sygnatariuszy zgodziło się na ujawnienie nazwisk, a reszta pozostała anonimowa. Sygnatariusze odwołują się wprost do precedensu Project Maven z 2018 r., kiedy wewnętrzny bunt wymusił na Google rezygnację z jednego z wojskowych kontraktów AI i przyjęcie zasad „etycznej AI”; krytycy zwracają jednak uwagę, że dziś stawka na rynku utajnionych projektów obronnych jest wielokrotnie wyższa, więc konflikt między etosem „don’t be evil” a presją Pentagonu raczej dopiero się rozkręca, niż że został wtedy rozwiązany.

Czego konkretnie domagają się pracownicy

W liście, który został dostarczony do Pichai w poniedziałek, pracownicy piszą, że są zaniepokojeni trwającymi negocjacjami między $GOOG a Departamentem Obrony USA w sprawie wdrożenia systemów Gemini/AI w tajnych projektach. Jako eksperci od sztucznej inteligencji ostrzegają, że systemy te "centralizują władzę i popełniają błędy", a ich bliskość z technologią nakłada na nich odpowiedzialność za wskazanie najbardziej niebezpiecznych i etycznych zastosowań.

Kluczowy fragment listu, zgodnie z opublikowanymi cytatami, mówi, że "jedynym sposobem na zapewnienie, że Google nie będzie kojarzony z takimi szkodami, jest odrzucenie wszelkich niejawnych obciążeń" dla wojska. Pracownicy ostrzegają, że w przeciwnym razie sztuczna inteligencja mogłaby zostać wykorzystana w autonomicznej broni lub masowej inwigilacji bez ich wiedzy lub możliwości interwencji.

Autorzy listu argumentują również ryzyko reputacyjne: zła decyzja w tym momencie może "nieodwracalnie zaszkodzić reputacji Google, jego działalności i roli na świecie". Firma nie skomentowała jeszcze publicznie listu, ale według doniesień medialnych od kilku tygodni rozważa zawarcie umowy z Pentagonem, która opierałaby się na sporze departamentu z Anthropic.

Kontekst: spór Pentagonu z Anthropic i "otwarta przestrzeń" dla innych firm zajmujących się sztuczną inteligencją

Napięcia związane z wykorzystaniem sztucznej inteligencji w wojsku nasiliły się po tym, jak Departament Obrony USA uznał Anthropic i jego model Claude za "ryzyko łańcucha dostaw" i zaczął wypychać firmę z projektów wojskowych. Oznaczenie to oznaczało, że Pentagon i jego kontrahenci nie mogli wykorzystywać Claude w kontraktach wojskowych, a Anthropic walczy w sądach, argumentując, że jest to odwet za odmowę zezwolenia na wykorzystanie sztucznej inteligencji "do wszystkich zgodnych z prawem celów", w tym w pełni autonomicznej broni.

Jak dotąd sąd tymczasowo zablokował departament przed podjęciem pewnych działań, ale Anthropic jest obecnie skutecznie odcięty od kontraktów obronnych, co stwarza przestrzeń dla innych dużych graczy - zazwyczaj Microsoft $MSFT, OpenAI lub po prostu Google. Według The Information, Pentagon prowadzi rozmowy z Google w celu wdrożenia swojej sztucznej inteligencji (Gemini) w środowisku niejawnym, co częściowo wypełniłoby lukę pozostawioną przez Anthropic.

Teraz pracownicy odpowiadają: w liście wyraźnie stwierdzają, że "nie chcą wypełniać pustki pozostawionej przez Anthropic", jeśli oznacza to wykorzystanie sztucznej inteligencji do wątpliwych celów wojskowych. Według Gizmodo, wśród sygnatariuszy są osoby z DeepMind, Google Cloud i innych zespołów, tj. bezpośrednio pracujących nad modelami i infrastrukturą na dużą skalę.

Powrót do Project Maven w 2018 roku

Obecna petycja nawiązuje do wcześniejszego, bardzo drażliwego rozdziału w historii Google: protestu Project Maven z 2018 roku. To właśnie wtedy tysiące pracowników sprzeciwiło się współpracy z Pentagonem w celu wykorzystania uczenia maszynowego do analizy nagrań z dronów i poprawy celowania, a niektórzy z nich opuścili firmę z tego powodu.

W liście z 2018 r. poproszono wówczas Google, by "nie zajmował się wojną" i przyjął jasną politykę nie rozwijania technologii w celu prowadzenia operacji bojowych. Po silnej wewnętrznej krytyce firma nie odnowiła kontraktu z Mavenem i obiecała bardziej rygorystyczne zasady etyczne dotyczące sztucznej inteligencji - to właśnie do tej tradycji odwołują się dzisiejsi sygnatariusze.

Obecny list sprawdza zatem, jak poważnie Google podchodzi do tych zasad w erze generatywnej sztucznej inteligencji, w której modele mogą być wdrażane znacznie szerzej - od przetwarzania danych wywiadowczych i planowania operacji po potencjalnie autonomiczne systemy uzbrojenia.

Co wchodzi w grę dla Google?

Z biznesowego punktu widzenia jest to delikatna równowaga między lukratywnym, ale ryzykownym pod względem reputacji segmentem "obronnej sztucznej inteligencji" a wizerunkiem firmy, która chce działać jako "odpowiedzialny" gracz w dziedzinie sztucznej inteligencji. Kontrakty wojskowe i rządowe w dziedzinie sztucznej inteligencji mogą przynieść długoterminowe kontrakty i stabilne przychody, ale otwierają również firmę na ostrą krytykę ze strony pracowników, opinii publicznej i niektórych partnerów zagranicznych.

Powtarzające się bunty wewnętrzne mogą

komplikować rekrutację najlepszych naukowców, którzy często wybierają pracodawców w oparciu o etykę projektu, a także

zmusić kierownictwo do odrzucenia niektórych lukratywnych kontraktów, tym samym "oddając" część rynku konkurentom

stworzyć precedens: gdy kierownictwo ustąpi, pracownicy będą częściej korzystać z podobnych narzędzi (listy otwarte, petycje).

Dla akcjonariuszy Alphabet istotne jest zatem śledzenie dwóch równoległych linii: jak rozwija się spór Pentagon-Antropic (tj. jak duże jest ogólne "okno możliwości" w obronie AI) oraz jakie wnioski wyciągnie Pichai i kierownictwo z obecnej presji wewnętrznej. Połączenie regulacji, reputacji i kultury wewnętrznej może być tutaj równie ważne dla wartości firmy, jak sama technologia.