Na MWC AMD pokazało Ryzen AI 400 oraz Ryzen AI PRO 400 dla komputerów stacjonarnych. To pierwsze procesory dla desktopowych Copilot+ PC z wbudowanym NPU do 50 TOPS, rdzeniami Zen 5 i grafiką RDNA 3.5. Firma chce, by „AI” było funkcją sprzętu, a nie tylko hasłem w chmurze.

Drugą nogą jest data center. Meta ma wdrożyć do 6 GW mocy obliczeniowej na Instinct GPU, a pierwsze dostawy mają ruszyć w drugiej połowie 2026 roku. Dla inwestora to ważne, bo AMD łączy dwa źródła wzrostu: premium PC i akceleratory AI. To może stopniowo podnieść pozycję negocjacyjną wobec Nvidii. Krótkoterminowo liczy się jednak tempo: jak szybko rynek desktopowych AI PC realnie urośnie i czy AMD dowiezie kilka dużych projektów jednocześnie.

Ryzen AI 400: sztuczna inteligencja na komputerach stacjonarnych

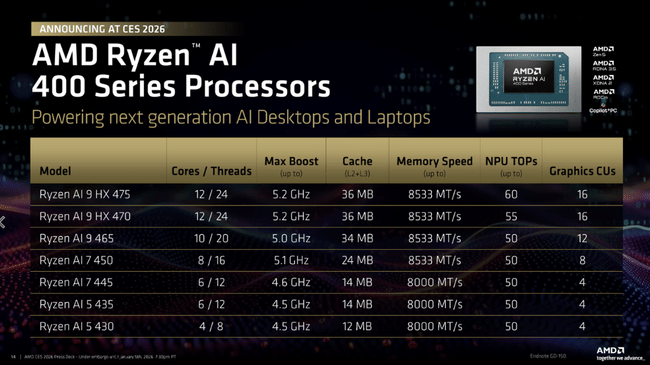

Nowe układy Ryzen AI 400 i Ryzen AI PRO 400 dla komputerów stacjonarnych bazują na połączeniu rdzeni Zen 5, zintegrowanej grafiki RDNA 3.5 i jednostek NPU drugiej generacji XDNA 2 z maksymalnie 50 TOPS, zaprojektowanych do lokalnego uruchamiania asystentów, aplikacji AI i modeli językowych. $AMD celuje w użytkowników, którzy chcą uruchamiać bardziej wymagające zadania AI - od aplikacji projektowych i inżynieryjnych po funkcje generatywne i lokalnie uruchamiane LLM - bez polegania na chmurze, co ma wpływ zarówno na prywatność, jak i opóźnienia. W segmencie PRO dodano funkcje zarządzania przedsiębiorstwem i funkcje bezpieczeństwa, dzięki czemu korporacje mogą ustandaryzować platformę desktopową AI z obsługą floty.

Portfolio obejmuje sześć modeli desktopów, z 8-rdzeniową konfiguracją Ryzen AI 7 450G/450GE (16 wątków, do 5,1 GHz, 8 CU Radeon 860M) i dwoma 6-rdzeniowymi modelami Ryzen AI 5 z Radeonem 840M, dostępnymi w wariantach 65W i 35W. W porównaniu do Ryzen 9000 z czystymi rdzeniami Zen 5, Ryzen AI 400 mają słabszą część CPU ze względu na wykorzystanie Zen 5c, ale lepszą zintegrowaną grafikę i co ważniejsze NPU - jest to więc inny rodzaj produktu niż czyste procesory do gier lub wydajności. AMD podaje w komunikacie prasowym, że systemy stacjonarne AM5 z Ryzen AI 400 będą dostępne od drugiego kwartału 2026 roku od głównych producentów OEM, takich jak HP $HPQ, Lenovo $LNVGY i Dell $DELL, co daje dobry sygnał, że nie będzie to linia marginalna.

Komputery AI jako nowa kategoria i miejsce AMD w niej

Ryzen AI 400 to pierwsze procesory do komputerów stacjonarnych dla tak zwanych komputerów Copilot+, maszyn zaprojektowanych do obsługi większości funkcji AI systemu Windows i aplikacji bezpośrednio na urządzeniu. Microsoft $MSFT ustalił minimalne wymagania dotyczące wydajności NPU dla Copilot+, a dzięki 50 TOPS AMD stawia się w parametrycznej podstawie przyszłego standardu AI PC. Tworzy to zarówno prostą historię marketingową dla producentów OEM ("AI PC"), jak i ramy techniczne, które faworyzują układy z NPU - konwencjonalne procesory bez dedykowanego akceleratora zajmują tylne miejsce w segmencie premium.

W przeszłości AMD było często postrzegane jako wybór w segmencie komputerów stacjonarnych pod względem wydajności/ceny lub maszyn do gier, podczas gdy segment profesjonalny i korporacyjny był silniej kojarzony z Intel $INTC. Ryzen AI PRO 400 może przełamać ten schemat, oferując firmom połączenie lokalnej sztucznej inteligencji, zintegrowanej grafiki dla zwykłego biura i zdalnego zarządzania w jednym pakiecie. Jeśli funkcje AI w głównych narzędziach pracy (Office, CAD, oprogramowanie kreatywne) staną się standardem, AMD może przesunąć się wyżej w łańcuchu wartości - od opcji czysto "wydajnościowej" do "preferowanej bazy" dla stacji roboczych AI.

Meta, 6 gigawatów i sztuczna inteligencja w centrach danych

Ale komputery stacjonarne nie są jedynym obszarem, w którym AMD robi postępy w dziedzinie sztucznej inteligencji. Pod koniec lutego ogłoszono rozszerzenie strategicznego partnerstwa z Meta Platforms w celu wdrożenia do 6 gigawatów infrastruktury AI opartej na procesorach graficznych Instinct i serwerach Helios. Pierwszy gigawat ma zostać dostarczony w drugiej połowie 2026 roku i będzie wykorzystywał niestandardowe układy GPU w architekturze MI450 oraz szóstą generację procesorów serwerowych EPYC "Venice". Dywersyfikuje to dostawców Meta poza Nvidię i daje AMD długoterminowe widoczne wolumeny w segmencie, w którym w przeciwnym razie konkuruje kawałek po kawałku.

Analizy rynkowe wskazują, że działalność AMD w zakresie sztucznej inteligencji opiera się na dwóch filarach: centrach danych i urządzeniach klienckich. Po stronie serwerów, MI400/MI450 ma zająć się szybko rozwijającym się wnioskowaniem i szkoleniami, a firmy takie jak Meta, Microsoft i inni gracze hiperskalowi szukają drugiego dostawcy obok Nvidii. Po stronie klienckiej, układy Ryzen AI 300/400 mają zapewnić możliwości sztucznej inteligencji bezpośrednio na komputerach PC i mobilnych stacjach roboczych - tworząc bazę, na której można sprzedawać licencje na oprogramowanie i usługi. Jeśli oba segmenty mogą być wdrażane równolegle, może to zbliżyć strukturę przychodów AMD do zdywersyfikowanego gracza AI, a nie tylko "outsidera" walczącego o udział.

Ryzyko i potencjalne skutki

Krótkoterminowe ryzyko polega przede wszystkim na tym, jak szybko kategoria komputerów AI realistycznie się rozwinie i jakie będą konkretne zamówienia od partnerów OEM w 2. i 3. kwartale. Jeśli popyt pozostanie bardziej falą marketingową niż rzeczywistą potrzebą aktualizacji pod kątem AI, wzrost Ryzen AI 400 może być wolniejszy niż sugeruje PR. Innym krótkoterminowym ryzykiem jest ryzyko technologiczne: AMD musi dostarczyć stabilne sterowniki, wsparcie oprogramowania i optymalizacje dla kluczowych aplikacji AI, w przeciwnym razie przewaga NPU zamieni się w papierowy parametr.

W perspektywie średnioterminowej dużą rolę odgrywa realizacja dużych kontraktów AI. Umowa na 6 GW GPU Instinct z Meta jest kapitałochłonna i obejmuje wiele generacji produktów; wszelkie poślizgi w produkcji MI450 lub EPYC "Venice" mogą przesunąć rozpoznawanie przychodów i zwiększyć koszty. Jednocześnie konkurencja ze strony Nvidia $NVDA i innych graczy oznacza, że AMD nie może opierać się na wysokiej premii cenowej, ale raczej na połączeniu wydajności i ceny, co może ograniczyć wzrost marży. Co więcej, w segmencie komputerów PC AMD konkuruje zarówno z Intelem, jak i nową generacją układów innych producentów skoncentrowanych na NPU, więc utrzymanie udziału będzie wymagało szybkiej iteracji mapy drogowej produktów.

W dłuższej perspektywie binarnym ryzykiem jest to, czy komputery PC ze sztuczną inteligencją faktycznie staną się standardem, czy też pozostaną stosunkowo wąską kategorią droższych urządzeń. Jeśli masowe wdrożenie "Copilot+" i podobnych platform zostanie opóźnione, AMD będzie musiało bardziej polegać na centrach danych i serwerach, gdzie ma mniejszy ekosystem i mniejszą moc w porównaniu do Nvidii. Innym binarnym elementem są duże kontrakty w chmurze: jeśli główny partner (zazwyczaj Meta) miałby znacząco zmniejszyć lub przenieść kontrakt na własne rozwiązania ASIC, uderzyłoby to bezpośrednio w oczekiwany wzrost. Regulacje eksportowe dotyczące zaawansowanych chipów i ryzyko geopolityczne są również czynnikami, które mogą mieć wpływ na część rynku, zwłaszcza w Chinach i innych wrażliwych regionach.

Co dalej

W nadchodzących miesiącach kluczowe będzie to, jakie konkretne modele komputerów stacjonarnych i stacji roboczych AI z Ryzen AI 400 zostaną ogłoszone przez HP, Lenovo i Dell oraz na jakich poziomach cenowych będą dostępne. Należy również uważnie obserwować wskaźniki wymienione w następnych wynikach kwartalnych AMD: wzrost przychodów w segmencie chipów klienckich, udział procesorów AI w miksie i trendy marży brutto. Po stronie centrów danych ważne będzie to, jak rozwijają się zamówienia na procesory graficzne Instinct, potwierdzenie innych dużych kontraktów po Meta oraz świadomość rynkowa dotycząca wzrostu MI400/MI450. Istotne będą również sygnały od Microsoftu i innych partnerów w zakresie oprogramowania dotyczące tego, czy optymalizują swoje funkcje sztucznej inteligencji głównie pod kątem platform NPU i w jaki sposób AMD uwzględnia te integracje.

Podsumowanie

Kluczową zmienną w historii AMD w 2026 r. staje się zdolność do przekształcenia swojej przewagi technicznej w zakresie procesorów NPU w prawdziwy standard komputerów AI, przy jednoczesnym dostarczaniu dużych kontraktów AI w centrach danych bez większych problemów. Jeśli komputery AI wystartują zgodnie z planem OEM, a kontrakt Meta przełoży się na widoczny wzrost w branży serwerów, obecna teza "AMD jako drugie źródło w AI" może przesunąć się w kierunku roli strukturalnego współlidera; punkt zwrotny nadejdzie, gdy komputery AI okażą się wąskim segmentem, a serwery AI pozostaną w rękach jednego dominującego rywala, ponownie otwierając pytanie, na ile dzisiejsza "premia AI" w wycenie AMD jest rzeczywiście uzasadniona.